🧠 Energy-Based Transformers — модель, которая умеет думать, а не просто угадывать

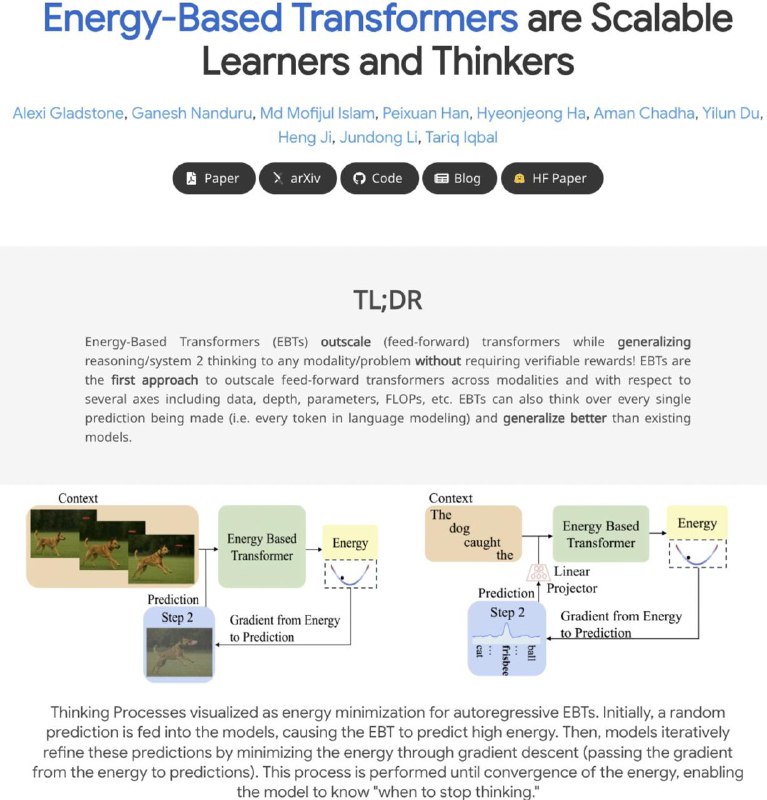

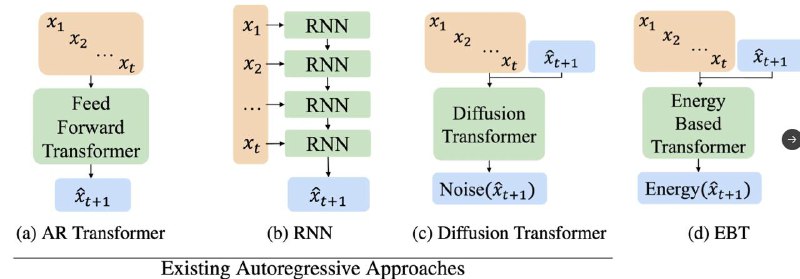

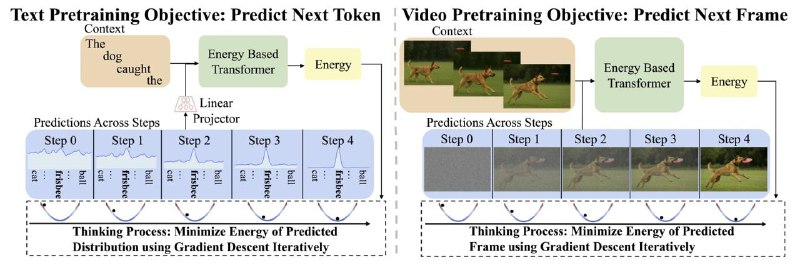

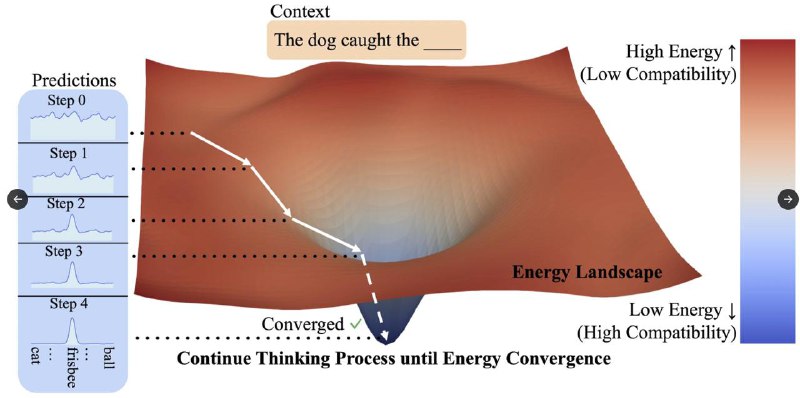

Новая архитектура EBT (Energy-Based Transformers) показывает, что трансформеры можно сделать умнее и универсальнее.

Что делает EBT:

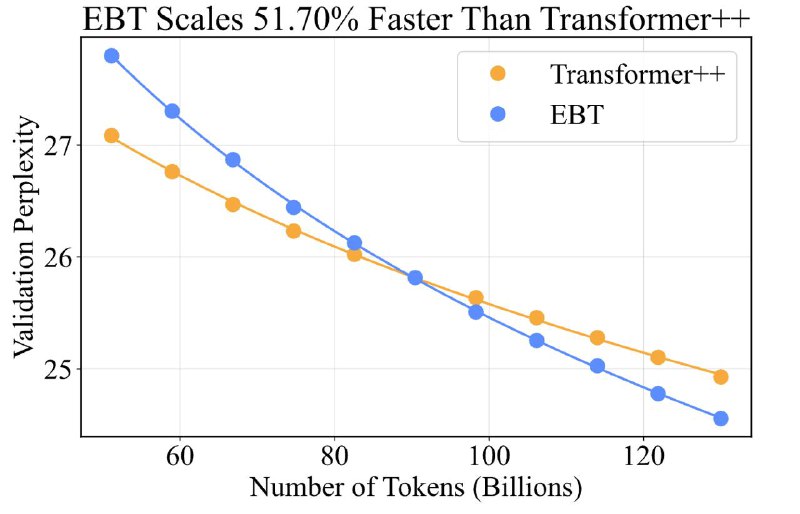

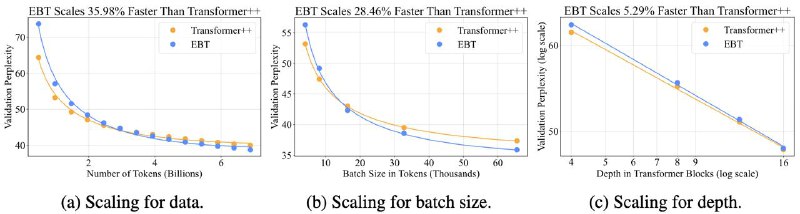

- 📊 Лучше классических трансформеров (включая Transformer++) по всем параметрам: данные, глубина, количество параметров, вычисления

- ⏱ При "долгом размышлении" даёт +29% прирост качества на тестах

- 🌍 Отлично работает с любыми типами данных: текст, видео, звук, 3D и др.

- 🧠 Умеет обобщать — справляется с новыми задачами без дообучения

- ❌ Не нуждается в наградах (как в reinforcement learning)

Почему это важно:

EBT — это шаг к ИИ, который способен реально *думать*, а не просто воспроизводить шаблоны. Он не просто быстрее, он глубже понимает, что делает.

Website: https://energy-based-transformers.github.io

Paper: https://arxiv.org/abs/2507.02092

@data_analysis_ml

Новая архитектура EBT (Energy-Based Transformers) показывает, что трансформеры можно сделать умнее и универсальнее.

Что делает EBT:

- 📊 Лучше классических трансформеров (включая Transformer++) по всем параметрам: данные, глубина, количество параметров, вычисления

- ⏱ При "долгом размышлении" даёт +29% прирост качества на тестах

- 🌍 Отлично работает с любыми типами данных: текст, видео, звук, 3D и др.

- 🧠 Умеет обобщать — справляется с новыми задачами без дообучения

- ❌ Не нуждается в наградах (как в reinforcement learning)

Почему это важно:

EBT — это шаг к ИИ, который способен реально *думать*, а не просто воспроизводить шаблоны. Он не просто быстрее, он глубже понимает, что делает.

Website: https://energy-based-transformers.github.io

Paper: https://arxiv.org/abs/2507.02092

@data_analysis_ml

❤11👍3🔥2

tgoop.com/data_analysis_ml/3791

Create:

Last Update:

Last Update:

🧠 Energy-Based Transformers — модель, которая умеет думать, а не просто угадывать

Новая архитектура EBT (Energy-Based Transformers) показывает, что трансформеры можно сделать умнее и универсальнее.

Что делает EBT:

- 📊 Лучше классических трансформеров (включая Transformer++) по всем параметрам: данные, глубина, количество параметров, вычисления

- ⏱ При "долгом размышлении" даёт +29% прирост качества на тестах

- 🌍 Отлично работает с любыми типами данных: текст, видео, звук, 3D и др.

- 🧠 Умеет обобщать — справляется с новыми задачами без дообучения

- ❌ Не нуждается в наградах (как в reinforcement learning)

Почему это важно:

EBT — это шаг к ИИ, который способен реально *думать*, а не просто воспроизводить шаблоны. Он не просто быстрее, он глубже понимает, что делает.

Website: https://energy-based-transformers.github.io

Paper: https://arxiv.org/abs/2507.02092

@data_analysis_ml

Новая архитектура EBT (Energy-Based Transformers) показывает, что трансформеры можно сделать умнее и универсальнее.

Что делает EBT:

- 📊 Лучше классических трансформеров (включая Transformer++) по всем параметрам: данные, глубина, количество параметров, вычисления

- ⏱ При "долгом размышлении" даёт +29% прирост качества на тестах

- 🌍 Отлично работает с любыми типами данных: текст, видео, звук, 3D и др.

- 🧠 Умеет обобщать — справляется с новыми задачами без дообучения

- ❌ Не нуждается в наградах (как в reinforcement learning)

Почему это важно:

EBT — это шаг к ИИ, который способен реально *думать*, а не просто воспроизводить шаблоны. Он не просто быстрее, он глубже понимает, что делает.

Website: https://energy-based-transformers.github.io

Paper: https://arxiv.org/abs/2507.02092

@data_analysis_ml

BY Анализ данных (Data analysis)

Share with your friend now:

tgoop.com/data_analysis_ml/3791