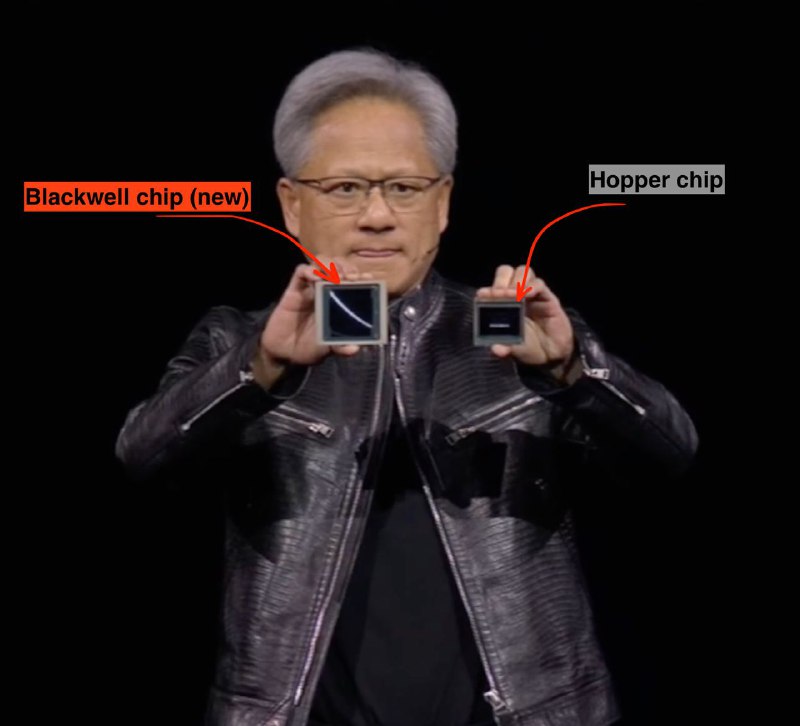

🔥Nvidia выкатила новые монстры для AI: Blackwell B200 GPU и GB200 "суперчип"Как всегда бывает на презентациях NVIDIA, слово "быстро" - это вчерашний день.

↪️ B200 GPU обещает до 20 петафлопс производительности в FP4 и 208 миллиардов транзисторов. Ваша GTX 1080 Ti нервно курит в сторонке.

↪️ В одной B200 будет 192GB памяти с пропускной способностью 8 ТБ/с. Идеально для LLM моделей, которые жрут память как не в себя и требуют большую пропускную способность.

↪️ GB200 "суперчип" объединяет 2 таких B200 GPU с одним Grace CPU (на ARM архитектуре). Nvidia хвастается, что это в 30 раз производительнее для инференса в LLM в FP4 по сравнению с H100.

↪️ Ключевая фишка - второе поколение трансформерного движка, который удваивает вычислительную мощность, пропускную способность и размер модели. Но хз, какая потеря точности будет после конвертации в FP4.

↪️ Nvidia утверждает, что GB200 снижает стоимость и энергопотребление в 25 раз по сравнению с H100 (опять же, в FP4).

↪️ Теперь будет поддерживаться и новый формат - FP6, золотая середина по скорости и точности между FP4 и FP8. Но бенчмарков не показали.

↪️ FP64 на уровне 45 терафлопс на GPU (против 60 у H100). Для нейронок double precision не релевантен, поэтому они особо и не парятся ускорять тут.

↪️ Тренировка GPT-MoE с 1.8 триллиона параметров (читай GPT-4) требовала 90 дней на 8,000 GH100 и 15МВт энергии. Теперь достаточно 2,000 GB200 и 4МВт. То есть во время тренировки 1x GB200 примерно в 4 раза быстрее чем 1x H100.

↪️ На инференсе GPT-3 с 175 млрд параметров, GB200 "всего" в 7 раз быстрее H100. Ну ладно, не все сразу.

Но не радуйтесь раньше времени - цены будут ядреными! Если H100 стоит около $40k, то GB200 будет минимум в 4-5 раз дороже.

Да и не достать их будет простым смертным. Первыми их получат Amazon, Google, Microsoft и Oracle. Известно, что Амазон уже планирует кластер на 20,000 GB200.

А потребительские версии Blackwell ожидаются не раньше 2025 г.

Ещё посты для интересующихся:

1.

Про H1002.

Про H100 NVL192GB3.

Про GH200@ai_newz