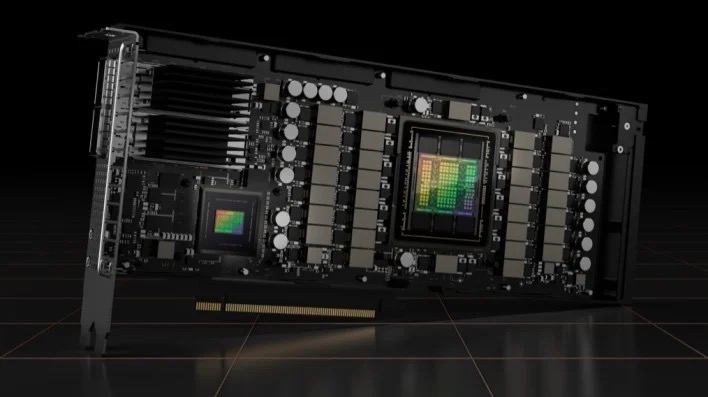

NVIDIA сегодня анонсировала свою новую видеокарту для AI-датацентров GH100

Что по спекам?

Полная реализация GH100 имеет следующие характеристики:

• 4-нм технология!

• 8 GPCs, 72 TPCs (9 TPCs/GPC), 2 SMs/TPC, 144 SMs per full GPU

• 128 FP32 CUDA Cores per SM, 18432 FP32 CUDA Cores per full GPU

• 4 Fourth-Generation Tensor Cores per SM, 576 per full GPU

• 6 HBM3 or HBM2e stacks, 12 512-bit Memory Controllers

• 60MB L2 Cache

• Fourth-Generation NVLink and PCIe Gen 5

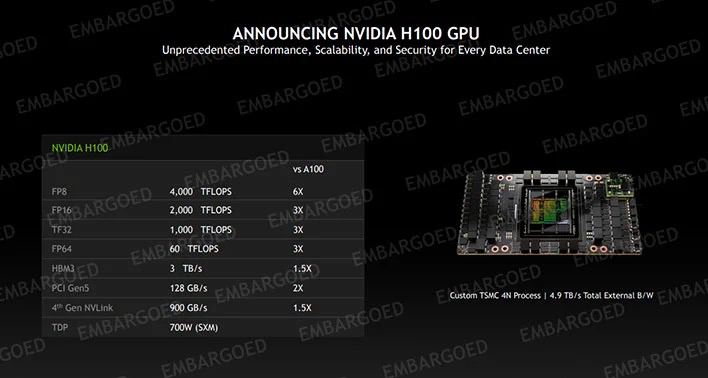

NVIDIA также заявляет, что ее вычислительные ядра включают в себя «Transformer Engine», который можно использовать для ускорения Трансформеров «до 6 раз» по сравнению с предыдущей арзитектурой Ampere. Сам «Transformer Engine», по-видимому, это подкрученные тензорные блоки (tensor units), которые работают на 8-битах, когда более высокая точность не требуется.

Компания утверждает, что чип H100 в три раза быстрее чем процессор A100 предыдущего поколения в вычислениях на FP64, FP32 и на FP16, при этом он в шесть (!) раз быстрее в 8-битных вычислениях.

Что по спекам?

Полная реализация GH100 имеет следующие характеристики:

• 4-нм технология!

• 8 GPCs, 72 TPCs (9 TPCs/GPC), 2 SMs/TPC, 144 SMs per full GPU

• 128 FP32 CUDA Cores per SM, 18432 FP32 CUDA Cores per full GPU

• 4 Fourth-Generation Tensor Cores per SM, 576 per full GPU

• 6 HBM3 or HBM2e stacks, 12 512-bit Memory Controllers

• 60MB L2 Cache

• Fourth-Generation NVLink and PCIe Gen 5

NVIDIA также заявляет, что ее вычислительные ядра включают в себя «Transformer Engine», который можно использовать для ускорения Трансформеров «до 6 раз» по сравнению с предыдущей арзитектурой Ampere. Сам «Transformer Engine», по-видимому, это подкрученные тензорные блоки (tensor units), которые работают на 8-битах, когда более высокая точность не требуется.

Компания утверждает, что чип H100 в три раза быстрее чем процессор A100 предыдущего поколения в вычислениях на FP64, FP32 и на FP16, при этом он в шесть (!) раз быстрее в 8-битных вычислениях.

🤯40🔥12👍9❤2🤔2👎1

tgoop.com/ai_newz/1033

Create:

Last Update:

Last Update:

NVIDIA сегодня анонсировала свою новую видеокарту для AI-датацентров GH100

Что по спекам?

Полная реализация GH100 имеет следующие характеристики:

• 4-нм технология!

• 8 GPCs, 72 TPCs (9 TPCs/GPC), 2 SMs/TPC, 144 SMs per full GPU

• 128 FP32 CUDA Cores per SM, 18432 FP32 CUDA Cores per full GPU

• 4 Fourth-Generation Tensor Cores per SM, 576 per full GPU

• 6 HBM3 or HBM2e stacks, 12 512-bit Memory Controllers

• 60MB L2 Cache

• Fourth-Generation NVLink and PCIe Gen 5

NVIDIA также заявляет, что ее вычислительные ядра включают в себя «Transformer Engine», который можно использовать для ускорения Трансформеров «до 6 раз» по сравнению с предыдущей арзитектурой Ampere. Сам «Transformer Engine», по-видимому, это подкрученные тензорные блоки (tensor units), которые работают на 8-битах, когда более высокая точность не требуется.

Компания утверждает, что чип H100 в три раза быстрее чем процессор A100 предыдущего поколения в вычислениях на FP64, FP32 и на FP16, при этом он в шесть (!) раз быстрее в 8-битных вычислениях.

Что по спекам?

Полная реализация GH100 имеет следующие характеристики:

• 4-нм технология!

• 8 GPCs, 72 TPCs (9 TPCs/GPC), 2 SMs/TPC, 144 SMs per full GPU

• 128 FP32 CUDA Cores per SM, 18432 FP32 CUDA Cores per full GPU

• 4 Fourth-Generation Tensor Cores per SM, 576 per full GPU

• 6 HBM3 or HBM2e stacks, 12 512-bit Memory Controllers

• 60MB L2 Cache

• Fourth-Generation NVLink and PCIe Gen 5

NVIDIA также заявляет, что ее вычислительные ядра включают в себя «Transformer Engine», который можно использовать для ускорения Трансформеров «до 6 раз» по сравнению с предыдущей арзитектурой Ampere. Сам «Transformer Engine», по-видимому, это подкрученные тензорные блоки (tensor units), которые работают на 8-битах, когда более высокая точность не требуется.

Компания утверждает, что чип H100 в три раза быстрее чем процессор A100 предыдущего поколения в вычислениях на FP64, FP32 и на FP16, при этом он в шесть (!) раз быстрее в 8-битных вычислениях.

BY эйай ньюз

Share with your friend now:

tgoop.com/ai_newz/1033