tgoop.com/ai_machinelearning_big_data/6369

Last Update:

DeepSeek-VL2 - усовершенствованная серия VLM c Mixture-of-Experts (MoE), которая значительно превосходит DeepSeek-VL.

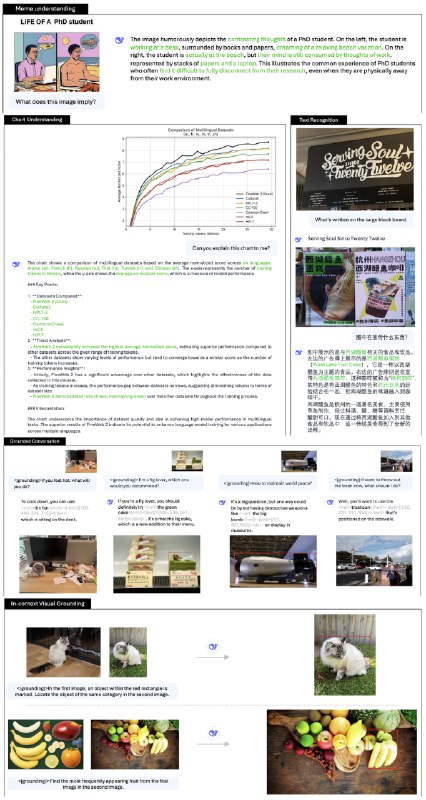

Модели семейства ориентированы на задачи визуальных ответов на вопросы, оптического распознавания символов, понимания документов/таблиц/схем и визуального обоснования.

DeepSeek-VL2 включает три основных модуля:

DeepSeek-VL2 обучается в три этапа: на первом этапе обучается MLP-соединитель, который связывает визуальный энкодер с языковой моделью, затем модель обучается на датасете из текста, изображений, аннотаций, QA и данных OCR и, в конце процесса, дообучается с учителем для улучшения ее способности понимать инструкции и вести диалог.

Модельная серия состоит из 3 вариантов c контекстом 4096:

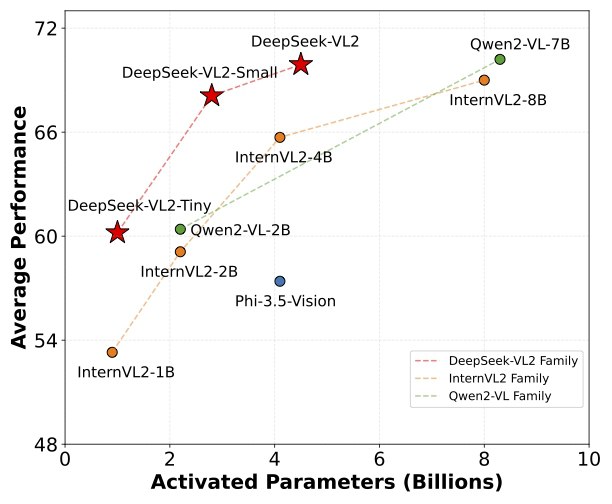

DeepSeek-VL2 была протестирована на задачах DocVQA, ChartQA, InfoVQA, TextVQA, MMBench и показала лучшие результаты по сравнению с другими моделями MoE.

DeepSeek-VL2 эффективно использует архитектуру MoE и превосходит другие модели с аналогичным количеством активных параметров.

@ai_machinelearning_big_data

#AI #ML #VLM #DeepSeek