tgoop.com/smalldatascience/881

Last Update:

#приёмы

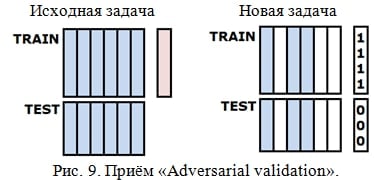

В старом посте я описывал приём AV: решение задачи разделения обучения и теста позволяет понять

1) какие признаки стабильны,

2) как отобрать обучающую подвыборку максимально похожую на тест.

Из того, что я тогда не сказал, но это полезно:

1) логично встроить AV в процедуру отбора признаков (чтобы отбиралось не просто подпространство с высоким качеством решения, но и стабильное),

2) когда нет теста (а его на практике часто и нет) можно разбить объекты по времени (странно, но при решении прикладных задач это делают очень редко),

3) из нестабильных признаков часто получаются хорошие стабильные, причём с помощью простых приёмов (например, доход клиента делим на медианных доход в этом месяце). Поэтому AV можно встроить и в генератор признаков;)

BY Small Data Science for Russian Adventurers

Share with your friend now:

tgoop.com/smalldatascience/881