tgoop.com/quant_prune_distill/437

Create:

Last Update:

Last Update:

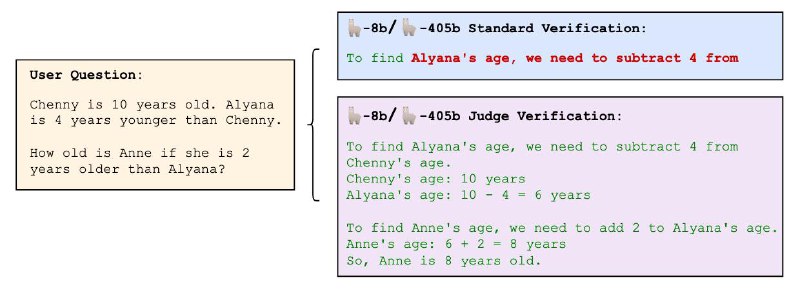

Judge Decoding: Faster Speculative Sampling Requires Going Beyond Model Alignment

[Статья][Кода нет]

Давно хотел коснуться темы ускорения инференса авторегрессионных моделей за счет спекулятивного декодинга, но все никак не доходили руки, и наконец дошли.

Команда исследователей из 00, среди которых небезызвестный автор канала @ai_newz, представила метод, ускоряющий спекулятивный декодинг за счет оценки важности текущего токена и принятия большего числа по сравнению с базовым подходом, при этом практически без просадки в качестве.

BY КПД

Share with your friend now:

tgoop.com/quant_prune_distill/437