tgoop.com/pytorch_howsam/546

Create:

Last Update:

Last Update:

احتمالا خبر دارید که اخیرا کنفرانس CVPR 2024 برگزار شد. میخوام، به مرور چند تا مقاله خوب و خوندنی این کنفرانس رو معرفی کنم. قبلا، Florence-2 رو معرفی کردم. امروز یک مقاله از حوزه شبکههای مگس وزن براتون آوردم! 😁

RepViT: Revisiting Mobile CNN From ViT Perspective

قبل از ظهور ترنسفورمر و ViT، شبکههای سبک و موبایلی زیادی داشتیم که مبتنی بر CNN بودن. مثل موبایلنت 1، 2، 3 و خیلی موارد دیگه. خب، در سالهای اخیر شبکههای موبایلی مبتنی بر ViT هم پیشنهاد شدن که اتفاقا از لحاظ سبکی و Latency بهتر از کانولوشنیها بودن. شبکههایی مثل FastViT، EfficientFormer و غیره.

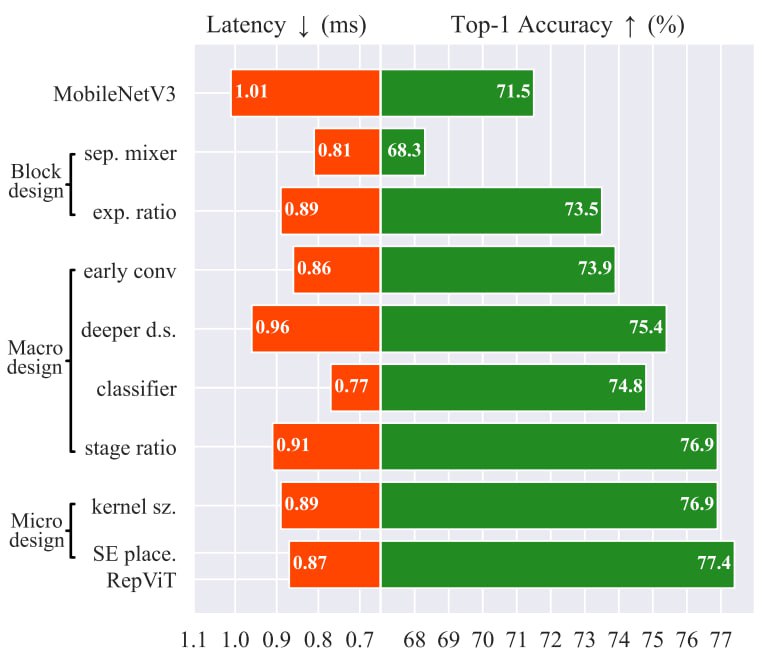

اما، توی این مقاله شبکهای مبتنی بر CNN پیشنهاد شده که مُچ شبکههای ترنسفورمری رو خوابونده! توی تصویر بالا هم میتونید مقایسه دقت و Latency بین این شبکه و سایرین رو ببینید.

ریپوی خوبی داره. وزنهاش در دسترسه. مورد استقبال قرار گرفته. همچنین، اومدن این شبکه رو با SAM (همون Segment Anything) ترکیب کردن و چیز جالبی دراومده! کد این هم توی ریپو موجود هست.

مقاله | گیتهاب

@pytorch_howsam

BY PyTorch Howsam

Share with your friend now:

tgoop.com/pytorch_howsam/546