tgoop.com/machinelearning_interview/1902

Last Update:

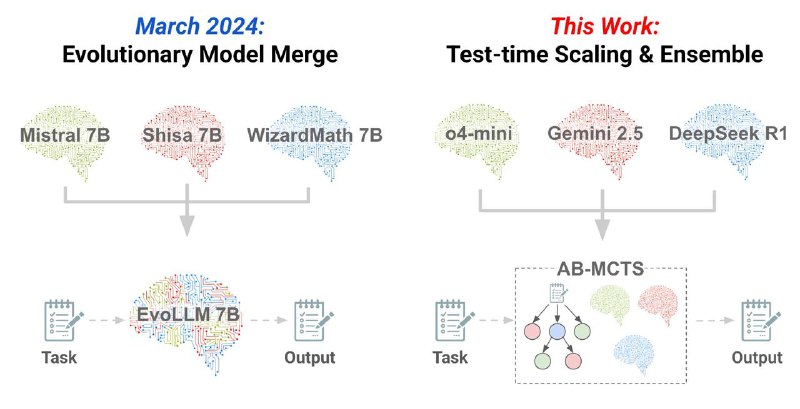

AB-MCTS (Adaptive Branching Monte Carlo Tree Search) — новый алгоритм масштабирования во время инференса, который обеспечивает коллективный интеллект для ИИ, позволяя нескольким передовым моделям (например, Gemini 2.5 Pro, o4-mini и DeepSeek-R1-0528) сотрудничать.

Sakana AI вдохновилась принципами коллективного интеллекта, где лучшие решения достигаются через объединение разнообразных мнений.

Каждая модель обладает своими сильными сторонами и уникальными свойствами, которые алгоритм использует в качестве ресурсов для совместного решения задач.

Ключевые особенности AB-MCTS:

• Коллективное сотрудничество моделей — алгоритм объединяет предложения разных моделей, выбирает наиболее многообещающие варианты и проверяет их через симуляции.

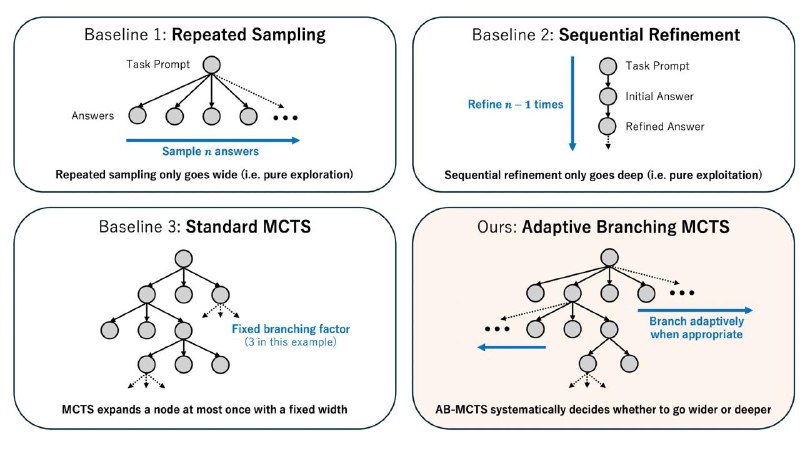

• Адаптивное ветвление — дерево поиска расширяется динамически там, где это приносит наибольшую пользу.

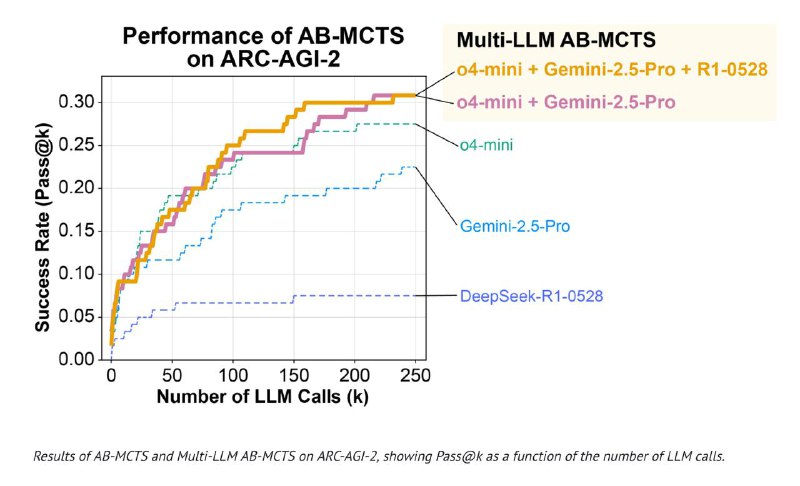

• Высокая эффективность на ARC-AGI-2 — комбинация o4-mini, Gemini 2.5 Pro и R1 0528 показывает значительный прирост по сравнению с каждой моделью в отдельности.

Авторы приводят следующие результаты работы алгоритма на 120 задачах ARC-AGI-2:

• Repeated Sampling (o4-mini): 23,0 % решённых задач

• AB-MCTS (o4-mini): 27,5 % решённых задач (абсолютный прирост +4,5 п.п., относительный +19,6 %)

• Multi-LLM AB-MCTS (o4-mini + Gemini 2.5 Pro + DeepSeek-R1-0528): > 30 % решённых задач

Sakana AI пытается внедрять принципы эволюции и коллективного интеллекта в разработку передовых ИИ-систем, с целью воплотить командный подход человеческих экспертов в мире искусственного интеллекта.

• Исходный код TreeQuest (реализация алгоритма): https://github.com/SakanaAI/treequest

• Эксперименты на ARC-AGI-2: https://github.com/SakanaAI/ab-mcts-arc2

• Подробнее в блоге: https://sakana.ai/ab-mcts

• Статья: https://arxiv.org/abs/2503.04412

@ai_machinelearning_big_data

#Sakana #al #ml