🌟 Новые российские открытые модели: T-Lite с 7 млрд. параметров и T-Pro — с 32.

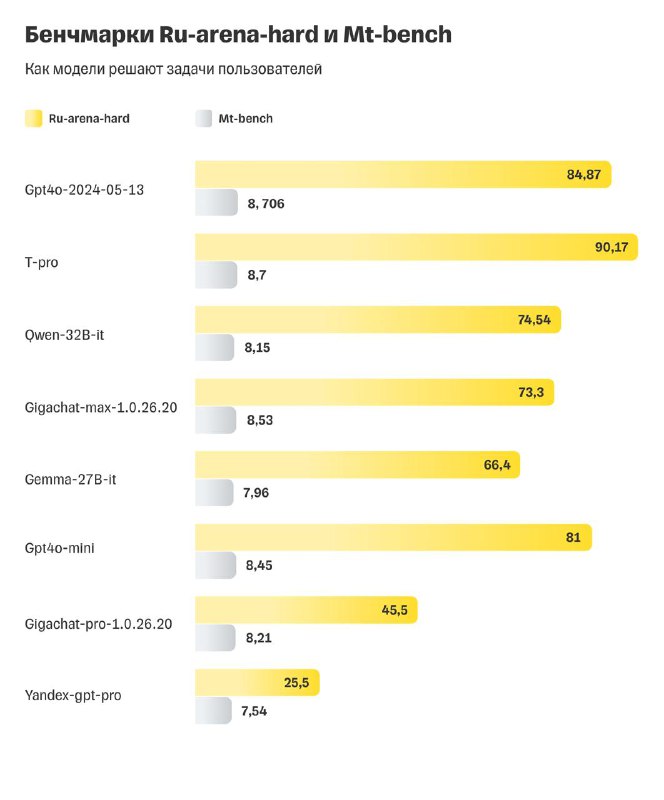

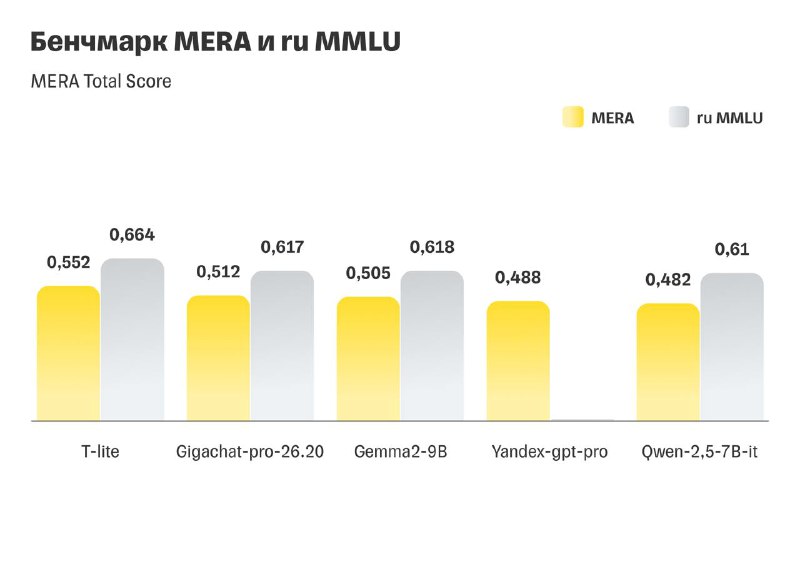

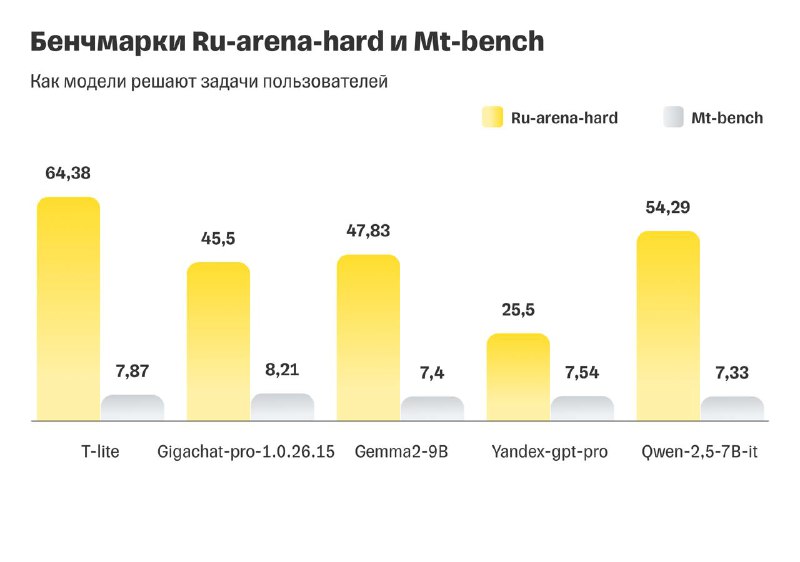

Доступ к T-Pro и обновленной T-Lite от “Т-Технологий (в составе Т-Банк) открыт для всех на платформе Hugging Face. Многочисленные индустриальные бенчмарки, в том числе ruMMLU, Ru Arena Hard, MT Bench и AlpacaEval, подтверждают статус лучших в мире открытых LLM на русском языке. По общему уровню знаний, умению вести диалог и справляться с практическими задачами T-Lite и T-Pro превосходят остальные российские и зарубежные модели. Также T-Pro и T-Lite обгоняют проприетарные модели OpenAI, Google и Anthropic.

Увеличенное число параметров у T-Pro до 32 млр. параметров делает модель более мощной и производительной, а также позволяет ей учитывать больше контекста и особенностей языка, лучше запоминать информацию, делать более точные и сложные выводы

▶️Модели входят в семейство специализированных языковых моделей “Т-Технологий” – Gen-T, которые справляются с решением конкретных задач, что не может предложить, например, ChatGPT.

▶️При разработке моделей используются технологии продолженного предобучения (Continual Pretraining). Таким образом, уже обученную на больших объемах информации модель можно достаточно дообучить под конкретные задачи.

@machinelearning_interview

#AI #ML #LLM

Доступ к T-Pro и обновленной T-Lite от “Т-Технологий (в составе Т-Банк) открыт для всех на платформе Hugging Face. Многочисленные индустриальные бенчмарки, в том числе ruMMLU, Ru Arena Hard, MT Bench и AlpacaEval, подтверждают статус лучших в мире открытых LLM на русском языке. По общему уровню знаний, умению вести диалог и справляться с практическими задачами T-Lite и T-Pro превосходят остальные российские и зарубежные модели. Также T-Pro и T-Lite обгоняют проприетарные модели OpenAI, Google и Anthropic.

Увеличенное число параметров у T-Pro до 32 млр. параметров делает модель более мощной и производительной, а также позволяет ей учитывать больше контекста и особенностей языка, лучше запоминать информацию, делать более точные и сложные выводы

▶️Модели входят в семейство специализированных языковых моделей “Т-Технологий” – Gen-T, которые справляются с решением конкретных задач, что не может предложить, например, ChatGPT.

▶️При разработке моделей используются технологии продолженного предобучения (Continual Pretraining). Таким образом, уже обученную на больших объемах информации модель можно достаточно дообучить под конкретные задачи.

@machinelearning_interview

#AI #ML #LLM

🔥12❤7👍7

tgoop.com/machinelearning_interview/1403

Create:

Last Update:

Last Update:

🌟 Новые российские открытые модели: T-Lite с 7 млрд. параметров и T-Pro — с 32.

Доступ к T-Pro и обновленной T-Lite от “Т-Технологий (в составе Т-Банк) открыт для всех на платформе Hugging Face. Многочисленные индустриальные бенчмарки, в том числе ruMMLU, Ru Arena Hard, MT Bench и AlpacaEval, подтверждают статус лучших в мире открытых LLM на русском языке. По общему уровню знаний, умению вести диалог и справляться с практическими задачами T-Lite и T-Pro превосходят остальные российские и зарубежные модели. Также T-Pro и T-Lite обгоняют проприетарные модели OpenAI, Google и Anthropic.

Увеличенное число параметров у T-Pro до 32 млр. параметров делает модель более мощной и производительной, а также позволяет ей учитывать больше контекста и особенностей языка, лучше запоминать информацию, делать более точные и сложные выводы

▶️Модели входят в семейство специализированных языковых моделей “Т-Технологий” – Gen-T, которые справляются с решением конкретных задач, что не может предложить, например, ChatGPT.

▶️При разработке моделей используются технологии продолженного предобучения (Continual Pretraining). Таким образом, уже обученную на больших объемах информации модель можно достаточно дообучить под конкретные задачи.

@machinelearning_interview

#AI #ML #LLM

Доступ к T-Pro и обновленной T-Lite от “Т-Технологий (в составе Т-Банк) открыт для всех на платформе Hugging Face. Многочисленные индустриальные бенчмарки, в том числе ruMMLU, Ru Arena Hard, MT Bench и AlpacaEval, подтверждают статус лучших в мире открытых LLM на русском языке. По общему уровню знаний, умению вести диалог и справляться с практическими задачами T-Lite и T-Pro превосходят остальные российские и зарубежные модели. Также T-Pro и T-Lite обгоняют проприетарные модели OpenAI, Google и Anthropic.

Увеличенное число параметров у T-Pro до 32 млр. параметров делает модель более мощной и производительной, а также позволяет ей учитывать больше контекста и особенностей языка, лучше запоминать информацию, делать более точные и сложные выводы

▶️Модели входят в семейство специализированных языковых моделей “Т-Технологий” – Gen-T, которые справляются с решением конкретных задач, что не может предложить, например, ChatGPT.

▶️При разработке моделей используются технологии продолженного предобучения (Continual Pretraining). Таким образом, уже обученную на больших объемах информации модель можно достаточно дообучить под конкретные задачи.

@machinelearning_interview

#AI #ML #LLM

BY Machine learning Interview

Share with your friend now:

tgoop.com/machinelearning_interview/1403