tgoop.com/llmsecurity/81

Last Update:

A New Era in LLM Security: Exploring Security Concerns in Real-World LLM-based Systems

Wu et al., 2024

Статья

В сегодняшней статье с претенциозным названием у нас интересный case study, в котором исследователи демонстрируют потенциальные уязвимости в ChatGPT, вызванные сложным взаимодействием компонентов.

Авторы отмечают, что большинство статей рассматривают атаки на LLM (джейлбрейки и промпт-инъекции) как независимую сущность. LLM, однако, полезна только в составе более сложной системы, но исследований безопасности систем на основе LLM гораздо меньше (мы рассматривали несколько: 1, 2, 3). Такие приложения можно анализировать с помощью подхода контроля потока данных (information flow control).

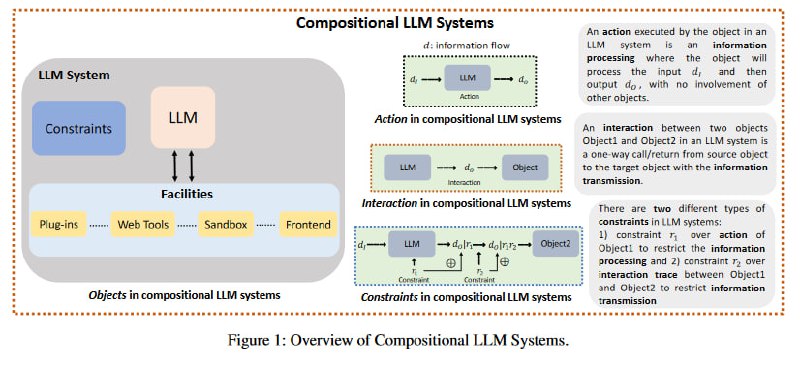

Для этого нам надо представить приложение как совокупность объектов, действий, взаимодействий и ограничений:

1. Объекты – это сама LLM, а также то, что входит в приложение, например, фронтенд, песочница, в которой исполняется код и хранятся файлы, плагины и так далее.

2. Действия – это то, что делает каждый объект сам по себе, получая некоторый ввод и генерируя вывод.

3. Взаимодействия – это процесс передачи информации от одного объекта к другому.

4. Ограничения – набор, собственно, ограничений над обработкой информации (действиями) или ее передачей (взаимодействиями).

BY llm security и каланы

Share with your friend now:

tgoop.com/llmsecurity/81