tgoop.com/llm_notes/214

Last Update:

🤖 MiniMax представила модель M1 с рекордным контекстным окном

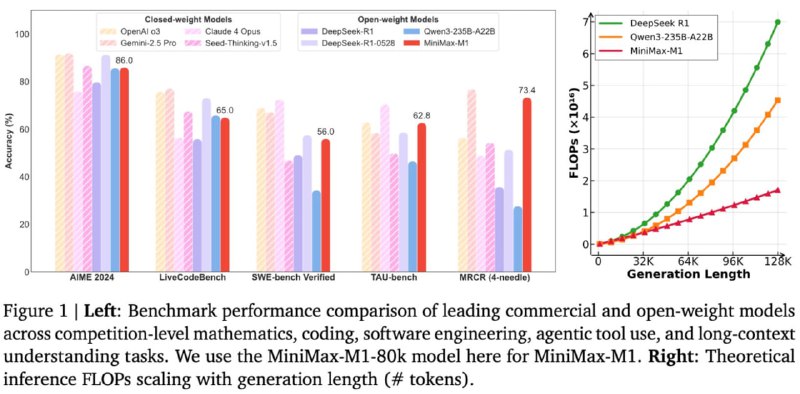

Китайский стартап MiniMax выпустил открытую модель M1 с контекстным окном в 1 миллион токенов. Модель показывает результаты, сопоставимые с ведущими открытыми моделями (а также с топовыми моделями Openai - o3 и Anthropic - Claude 4 Opus), при значительно меньших затратах на обучение.

Основные характеристики:

• Контекстное окно: 1M входных токенов

• "Бюджет размышлений": 80k токенов для вывода

• Особенно эффективна в разработке ПО и использовании инструментов (tool calling)

• Превосходит конкурентов в задачах с длинным контекстом

Технические детали:

1️⃣ Использован новый алгоритм обучения CISPO (Clipped IS-weight Policy Optimization)

2️⃣ Скорость обучения в 2 раза выше существующих методов

3️⃣ Полное обучение заняло 3 недели

4️⃣ Общая стоимость обучения: $535,000

Подробности в отчете

💡 Значение для индустрии:

Китайские лаборатории продолжают развивать открытые модели, расширяя границы возможностей работы с контекстом. Эффективность обучения M1 показывает, что новые подходы в архитектуре могут существенно снизить затраты на создание мощных ИИ-систем.

С таким большим контекстным окном было бы неплохо данную модель взять за основу в следующих версиях YandexGPT :)

💡 Как самим потестировать:

• Модель доступна на huggingface

• Есть также подробное описание на Github

• Чат-бот на базе этой модели здесь

• MCP-сервер модели тут

@llm_notes

#minimax #openai #longcontext #training #chinese

BY Заметки LLM-энтузиаста

Share with your friend now:

tgoop.com/llm_notes/214