tgoop.com/dsproglib/6633

Create:

Last Update:

Last Update:

Пропущенные данные — распространённая проблема в реальных проектах. Причины могут быть разными: ошибки при сборе, повреждение файлов, неполные опросы и прочее.

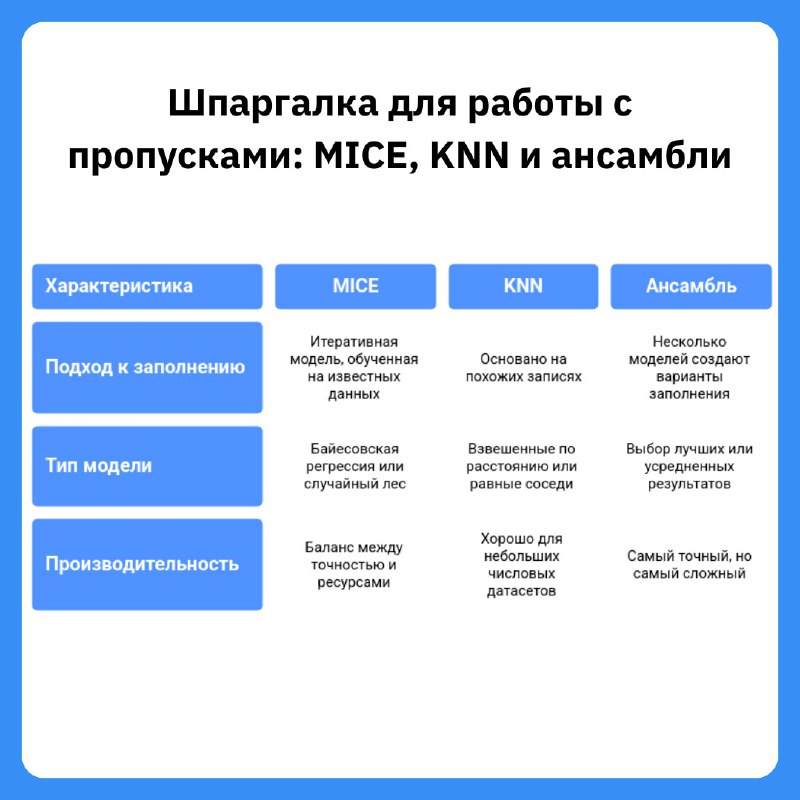

Представляем три продвинутых способа иммутации пропусков с использованием Pandas и Scikit-learn:

Использует модели, например, Байесовскую регрессию или случайный лес, чтобы последовательно заполнять пропуски, обучаясь на известных данных.

from sklearn.experimental import enable_iterative_imputer

from sklearn.impute import IterativeImputer

iterative_imputer = IterativeImputer(random_state=42, max_iter=10)

df_imputed = pd.DataFrame(iterative_imputer.fit_transform(df), columns=df.columns)

print(df_imputed.isnull().sum().sum()) # Пропусков больше нет

Можно менять модель, например, использовать RandomForestRegressor для иммутации.

Заполняет пропуски, опираясь на похожие строки с известными значениями. Вес соседей можно задавать по расстоянию или равномерно.

from sklearn.impute import KNNImputer

knn_imputer = KNNImputer(n_neighbors=5, weights='distance')

df_knn = pd.DataFrame(knn_imputer.fit_transform(df), columns=df.columns)

print(df_knn.isnull().sum().sum())

Запускаем разные иммутационные модели, получаем несколько вариантов заполненных данных, а затем выбираем лучший результат, ориентируясь на ключевые признаки:

from sklearn.linear_model import BayesianRidge

from sklearn.ensemble import ExtraTreesRegressor, RandomForestRegressor

imputers = {

'bayesian_ridge': IterativeImputer(estimator=BayesianRidge(), random_state=42),

'extra_trees': IterativeImputer(estimator=ExtraTreesRegressor(n_estimators=10, random_state=42), random_state=42),

'rf_regressor': IterativeImputer(estimator=RandomForestRegressor(n_estimators=10, random_state=42), random_state=42)

}

imputed_datasets = {}

for name, imputer in imputers.items():

imputed_datasets[name] = pd.DataFrame(imputer.fit_transform(df), columns=df.columns)

print(f"{name}: Средний доход = {imputed_datasets[name]['income'].mean():.2f}")

— KNN хорошо подходит для небольших числовых датасетов, но требует ресурсов на больших.

— Ансамблевые методы дают лучшее качество, но сложнее и тяжелее в вычислениях.

— MICE — золотая середина для многих задач.

Библиотека дата-сайентиста #буст