tgoop.com/bigdatai/750

Last Update:

Компания Neural Magic представила две квантованные FP8-версии модели Meta's Llama 3.1 405B Instruct:

Примененная оптимизация уменьшает количество бит на параметр с 16 до 8, сокращая требования к VRAM примерно на 50 %. FP8-модель может быть развернута помощью одного узла 8xH100 GPU.

Процесс квантования применялся исключительно к весам и активациям линейных операторов внутри блоков трансформеров. Использовалось симметричное поканальное квантование, которое включает линейное масштабирование по выходному измерению для отображения представлений FP8 квантованных весов и активаций.

Кроме того, активации квантованы динамически на основе каждого токена.

Для квантования использовалась библиотека оптимизации LLM Compressor с набором 512 последовательностей UltraChat.

Обе FP8 модели сохраняют архитектуру Meta-Llama-3.1 и могут быть запущены на бэкенде vLLM.

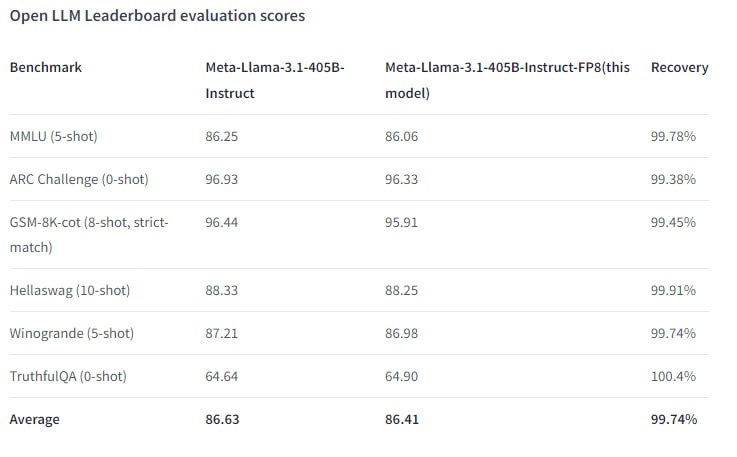

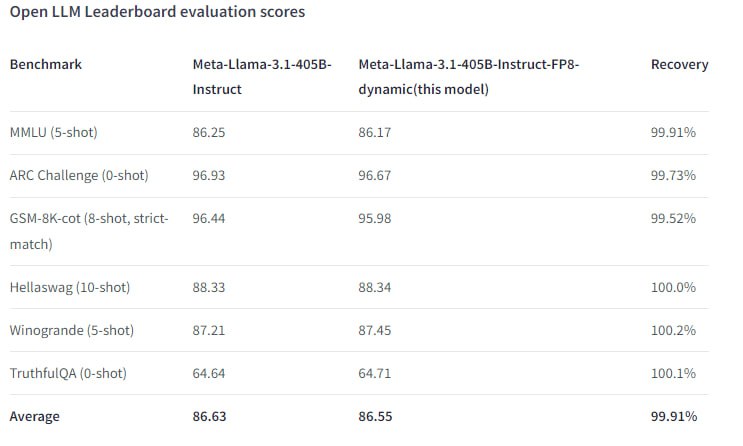

В бенчмарке OpenLLM версия FP8-dynamic получила средний балл 86,55. Это максимально близко к результату оригинальной модели - 86,63 (99,91%).

@ai_machinelearning_big_data

#AI #ML #LLM #Llama #FP8