✨Яндекс разработал алгоритм, позволяющий сжимать языковые модели в 8 раз без потери качества

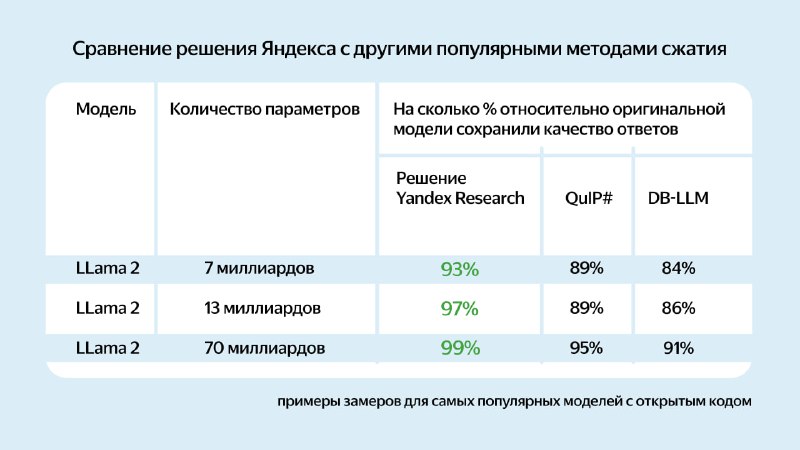

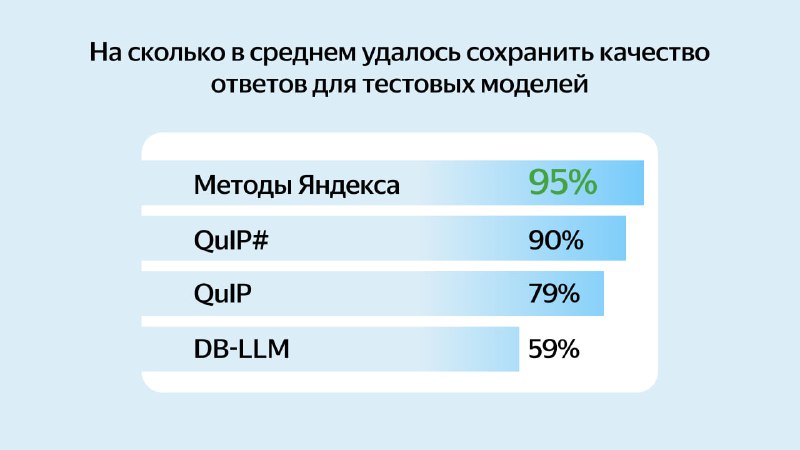

Команда Yandex Research совместно с исследователями IST Austria разработала новые методы сжатия больших языковых моделей и выложила их в опенсорс. При уменьшении моделей этим способом в 8 раз исследователям удалось сохранить качество ответов в среднем на 95%.

Решение позволит компаниям и независимым разработчикам значительно сэкономить потребляемые ресурсы и ускорить работу нейросетей. Например, запускать модели на устройствах с небольшой вычислительной мощностью.

Статья о новом подходе вошла в программу международной конференции по машинному обучению ICML: https://habr.com/ru/companies/yandex/articles/830410

@bigdatai

Команда Yandex Research совместно с исследователями IST Austria разработала новые методы сжатия больших языковых моделей и выложила их в опенсорс. При уменьшении моделей этим способом в 8 раз исследователям удалось сохранить качество ответов в среднем на 95%.

Решение позволит компаниям и независимым разработчикам значительно сэкономить потребляемые ресурсы и ускорить работу нейросетей. Например, запускать модели на устройствах с небольшой вычислительной мощностью.

Статья о новом подходе вошла в программу международной конференции по машинному обучению ICML: https://habr.com/ru/companies/yandex/articles/830410

@bigdatai

👍10❤3🔥3

tgoop.com/bigdatai/741

Create:

Last Update:

Last Update:

✨Яндекс разработал алгоритм, позволяющий сжимать языковые модели в 8 раз без потери качества

Команда Yandex Research совместно с исследователями IST Austria разработала новые методы сжатия больших языковых моделей и выложила их в опенсорс. При уменьшении моделей этим способом в 8 раз исследователям удалось сохранить качество ответов в среднем на 95%.

Решение позволит компаниям и независимым разработчикам значительно сэкономить потребляемые ресурсы и ускорить работу нейросетей. Например, запускать модели на устройствах с небольшой вычислительной мощностью.

Статья о новом подходе вошла в программу международной конференции по машинному обучению ICML: https://habr.com/ru/companies/yandex/articles/830410

@bigdatai

Команда Yandex Research совместно с исследователями IST Austria разработала новые методы сжатия больших языковых моделей и выложила их в опенсорс. При уменьшении моделей этим способом в 8 раз исследователям удалось сохранить качество ответов в среднем на 95%.

Решение позволит компаниям и независимым разработчикам значительно сэкономить потребляемые ресурсы и ускорить работу нейросетей. Например, запускать модели на устройствах с небольшой вычислительной мощностью.

Статья о новом подходе вошла в программу международной конференции по машинному обучению ICML: https://habr.com/ru/companies/yandex/articles/830410

@bigdatai

BY Big Data AI

Share with your friend now:

tgoop.com/bigdatai/741