⚡️ Обновление семейства Nemotron: теперь с ризонингом.

NVIDIA

выпустила новые модели и датасет семейства Nemotron :

🟢Модель

Llama-3.3-Nemotron-Super-49B-v1🟢Модель

Llama-3.1-Nemotron-Nano-8B-v1🟠Датасет

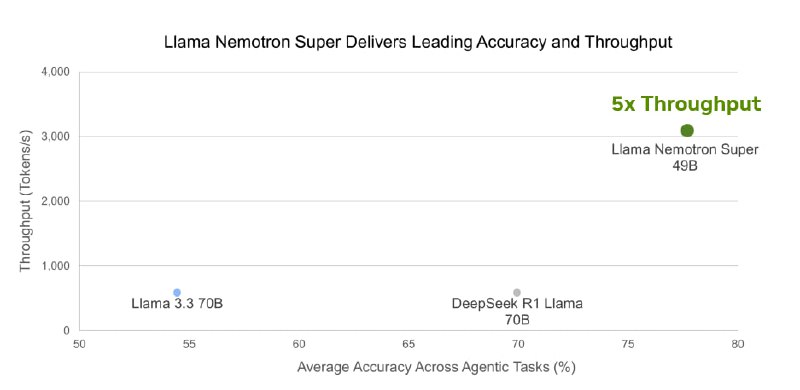

Llama-Nemotron-Post-Training-Dataset-v1▶️Llama-3.3-Nemotron-Super-49B-v1 — флагманская мультиязычная модель, созданная на базе Llama-3.3-70B-Instruct и оптимизированная для ризонинга, чат-взаимодействий и RAG-систем, с контекстным окном 128 тыс. токенов. Ключевая особенность — применение в процессе создания Neural Architecture Search (NAS), метода, который позволил сократить вычислительные затраты без значительной потери качества.

Архитектура модели, впервые для семейства Nemotron, использует нестандартные блоки: в части слоев внимание заменено линейными преобразованиями, а параметры FFN-слоев варьируются между блоками. Это позволило адаптировать модель для работы на одном GPU H100-80GB.

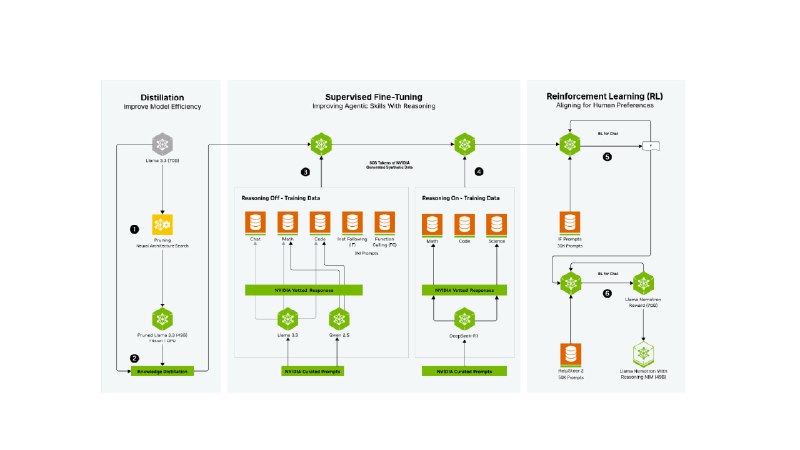

Обучение проходило в несколько этапов: от дистилляции знаний на 40 млрд. токенов до тонкой настройки с RL-алгоритмами (RPO и REINFORCE).

Результаты тестов впечатляют: в режиме «рассуждений» модель демонстрирует 96,6% pass@1 на MATH500 и 58,4% на AIME25, превосходя базовые показатели.

Модель умеет переключаться между ризонинг-режимом и типовым LLM-инференсом: для режима рассуждений рекомендуется свой системный промпт и параметры t=0,6 и Top-P=0,95.

Модель ориентирована на создание ИИ-агентов, чат-ботов, систем с расширенным контекстом и доступна

через API, в веб-демо на

NVIDIA Build и веса для скачивания на

HuggingFace.

▶️Llama-3.1-Nemotron-Nano-8B-v1 - младшая модель с 8 млрд. параметров, которая предлагает компромисс между точностью и эффективностью. Она создана на основе Llama 3.1 8B Instruct и предлагает улучшение точности базовой Llama 3.1, возможности в рассуждениях, как и флагманская. Модель подходит для запуска на одном GPU RTX и может использоваться локально. Nano-8B-v1 поддерживает длину контекста 128 тыс. токенов.

▶️Llama-Nemotron-Post-Training-Dataset-v1 - набор данных объемом 15.2 млн строк, который представляет собой компиляцию данных SFT и RL для улучшения математических, кодовых, общих рассуждений и возможностей следования инструкциям оригинальной модели Llama.

📌Лицензирование:

NVIDIA Open Model License🟡Статья🟡Коллекция Nemotron на HF🟡Arxiv@ai_machinelearning_big_data#AI #ML #LLM #NVIDIA #Nemotron