tgoop.com/ITDialog_official/690

Last Update:

Deepfake-технологии стремительно развиваются, а судебная практика и правовое регулирование всё ещё на этапе формирования

Даже шуточный ролик, где чьё-то лицо или голос сгенерированы нейросетью, способен привести к серьёзным репутационным проблемам или стать инструментом шантажа. В России уже фиксировались попытки создания фейковых сообщений от имени известных предпринимателей: дипфейковые ролики активно рекламировали «супердоходы» на мошеннических сайтах.

Подделку иногда трудно распознать с первого взгляда, что облегчает манипулирование общественным мнением. Но мошенники на этом не останавливаются: всё чаще сотрудники российских компаний и госорганизаций становятся целью «цифровых двойников» коллег, которые запрашивают конфиденциальные сведения или требуют срочной оплаты.

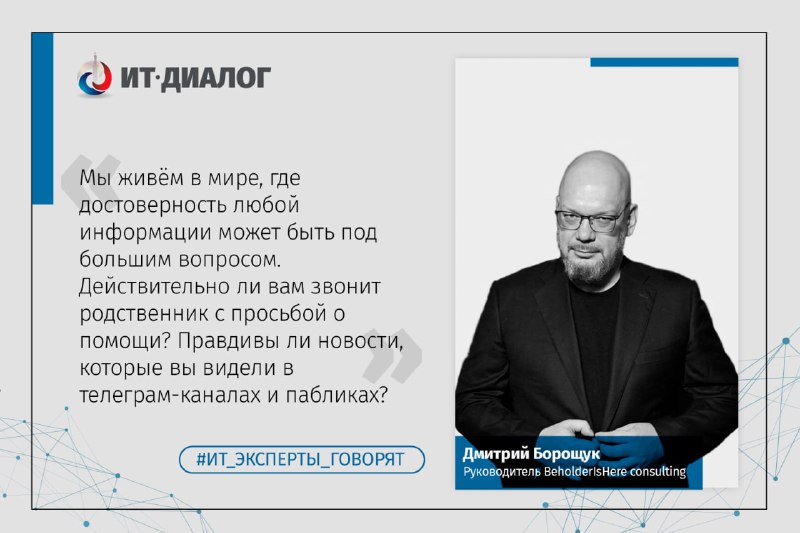

«Мы живём в мире, где достоверность любой информации может быть под большим вопросом. Действительно ли вам звонит родственник с просьбой о помощи? Правдивы ли новости, которые вы видели в телеграм-каналах и пабликах? Счёт на оплату от вашего проверенного контрагента действительно ли ведёт именно к нему?

4 апреля поговорим о том, как распознать различные виды deepfake-медиа и о том, как можно подделать всё — от бумажного документа до новостей в массмедиа»,

— отмечает Дмитрий Борощук, руководитель консалтингового бюро BeholderIsHere consulting.

4 апреля на конференции «КИБЕРКОНТУР 2025» Дмитрий Борощук выступит на мастер-классе «Противодействие социальной инженерии» и расскажет, как вовремя отличить дипфейк от реальности и не оказаться в эпицентре аферы.

Мероприятие проводится совместно с изданием IT-Manager при поддержке Комитета по информатизации и связи.

📌 Регистрация на конференцию доступна на сайте «ИТ-Диалога».

BY ИТ-Диалог

Share with your friend now:

tgoop.com/ITDialog_official/690