tgoop.com/AlgorithmDesign_DataStructuer/1727

Last Update:

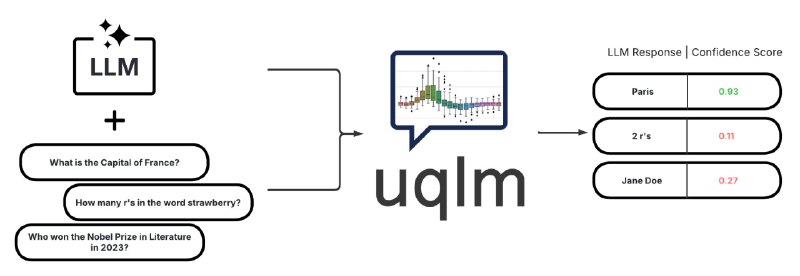

🔍🤖 UQLM: Hallucination Detection Library

در دنیای مدلهای زبانی بزرگ (LLMs)، یکی از چالشهای مهم، تولید اطلاعات نادرست یا ساختگی (Hallucination) است که میتواند به خروجیهای غیرقابل اعتماد منجر شود.

اینجاست که UQLM وارد میشود!

✨ در واقع UQLM یک کتابخانهی کاربردی برای شناسایی و تشخیص Hallucination در خروجی مدلهای زبانی است. این ابزار با اندازهگیری عدم قطعیت (Uncertainty) در پاسخها و استفاده از روشهای امتیازدهی متنوع، امکان تحلیل دقیقتری از صحت خروجیها را فراهم میکند.

🧩 یکی از ویژگیهای جذاب UQLM، یکپارچگی کامل با LangChain است. این یعنی توسعهدهندگان میتوانند خیلی راحت این ابزار را در زنجیرههای کاری خود پیادهسازی کنند و برنامههای هوش مصنوعی قابل اطمینانتر و هوشمندتری بسازند.

https://github.com/cvs-health/uqlm

#هوش_مصنوعی

📣👨💻 @AlgorithmDesign_DataStructuer

BY Algorithm design & data structure

Share with your friend now:

tgoop.com/AlgorithmDesign_DataStructuer/1727